Hoe kunnen AI-systemen zo worden ontworpen dat de mens nog steeds voldoende controle heeft? Na jaren onderzoek hebben Delftse onderzoekers en hun internationale collega’s een handboek geschreven over ‘betekenisvolle menselijke controle’ op systemen met autonome eigenschappen.

Leveranciers van intelligente systemen zeggen graag zeggen dat de mens altijd eindverantwoordelijk is, maar hoe realistisch is dat wanneer zich plotseling een noodsituatie voordoet? Hoe snel kan een mens dan nog ingrijpen? Om dit te adresseren, is het concept ‘betekenisvolle menselijke controle’ geïntroduceerd.

Dit concept is in de afgelopen tien jaar een steeds belangrijkere rol gaan spelen in het wetenschappelijk onderzoek aan de TU Delft naar systemen met autonome eigenschappen.

David Abbink, hoogleraar haptic human-robot interaction en wetenschappelijk directeur van het interdisciplinaire onderzoeksinstituut AiTech: “In de kern draait ‘betekenisvolle menselijke controle’ om het standpunt dat verantwoordelijkheid nooit aan een ‘autonoom systeem’ toegedicht moet worden, maar aan mensen. Eigenlijk zijn er geen autonome systemen, alleen systemen met autonome eigenschappen, en die worden ontwikkeld, geïmplementeerd, gebruikt en misbruikt door mensen. Die moeten dan wel de juiste verantwoordelijkheid voelen en ook de reëel mogelijkheid hebben om te kunnen ingrijpen. Dan spreken we van betekenisvolle menselijke controle. Het is een concept waar ethici, bedrijfskundigen, ontwerpers en ingenieurs zich samen over moeten buigen, en dat maakt het wetenschappelijk en maatschappelijk ingewikkeld.”

Praktisch

Maar hoe maak je dat praktisch toepasbaar?

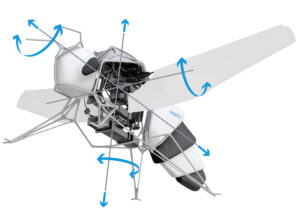

“In ons position paper hebben we vier eigenschappen gedefinieerd die daarbij moeten helpen. Ter illustratie hebben we twee praktische toepassingen gekozen: geautomatiseerde overtuigen en AI-gebaseerde rekrutering van werknemers. Neem een semi-autonome auto. Hierbij kun je een technisch domein afbakenen waarbinnen de auto autonoom rijdt, bijvoorbeeld op de snelweg. Maar als er zich een onverwachte situatie voordoet, bijvoorbeeld een motorrijder die plotseling voorlangs kruist, dan moet de mens het overnemen. Op basis van de situaties die de mens zou moeten overnemen kunnen we dan ook een moral operational design domain afbakenen. Daarmee bakenen we af waarvoor mensen verantwoordelijk zijn en waarvoor de machine. Dat kunnen we ook doen bij AI-gebaseerde rekrutering of andere mens-AI-systemen. Het moral operational design domain is de eerste eigenschap die nodig is voor het operationaliseren van betekenisvolle menselijke controle.

“Om een mens-AI systeem goed te laten functioneren moeten zowel de betrokken mensen als het AI-systeem een bepaalde voorstelling hebben van de taken, rolverdelingen, gewenste resultaten, en ook van de omgeving en de wederzijdse mogelijkheden en beperkingen. Dat is de tweede belangrijke eigenschap. Die voorstellingen of representaties worden vaak mentale modellen genoemd en deze tweede eigenschap is dus gebaseerd op gedeelde mentale modellen van alle betrokkenen bij het mens-AI-systeem. Wij bevelen aan om gesprekken hierover expliciet mee te nemen in het ontwikkelingsproces van het mens-AI-systeem. Dat gebeurt niet automatisch.”

“De derde eigenschap zegt dat de verantwoordelijkheid die aan een mens wordt toegekend in verhouding moet staan tot het vermogen en de autoriteit van die mens om het systeem ook daadwerkelijk te controleren. Wij vinden dat je als mens alleen maar verantwoordelijk gehouden kunt worden als je ook praktisch en realistisch gezien de mogelijkheid hebt om in te grijpen. Met deze gedachte in het achterhoofd kun je een bestuurder van een semi-autonome auto niet verantwoordelijk houden voor een ongeluk wanneer hij niet genoeg tijd heeft om de controle over de auto terug te krijgen van de autopilot.

Ten vierde moeten de handelingen van het AI-systeem altijd gelinkt kunnen worden aan minstens één persoon die zich ook nog eens bewust is van de morele verantwoordelijkheid.”

Centre for Meaningful Human Control over AI

TU Delft richt ook een Centre for Meaningful Human Control over AI op. Het belangrijkste doel is om ‘een robuust begrip, netwerk en succesverhalen’ te delen, die bijdragen aan een verantwoorde ontwikkeling van AI. Het Centre wordt dit voorjaar gelanceerd.