Corona heeft videocommunicatie een enorme impuls gegeven. Maar het gaat niet altijd van een leien dakje; slechte transmissiekwaliteit, uitval en onder en verbrekingen stellen tijdens de online vergaderingen of gesprekken het geduld van de deelnemers danig op de proef. Onderzoekers hebben een nieuw ontwikkelde methode voor videoconferenties over hele lage bandbreedtes getest – met een duik naar de Titanic, 4000 m diep in de Noord-Atlantische Oceaan.

“Het is heel moeilijk om gegevens van een diepte van vier kilometer zonder verlies door zout water te zenden,” zegt professor Alex Waibel, die onderzoek doet naar spraakomzetting aan het Karlsruher Institut für Technologie (KIT) en de Carnegie Mellon University (CMU). Door de natuurlijke omstandigheden is namelijk overdracht van onderzeeër op de zeebodem naar het oppervlakteschip alleen mogelijk via sonar – radiocommunicatie werkt niet in zout water.

Communicatie alleen via sonar

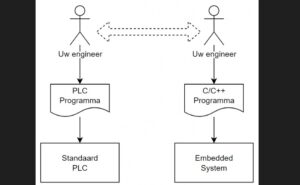

De onderzoekers hebben kunstmatige methoden ontwikkeld om video’s met tekst te kunnen reconstrueren. De geluidsopname wordt in de onderzeeër eerst in tekst omgezet, vervolgens met sonargeluidspulsen naar boven gezonden en daar weer omgezet naar video. “In de video is dan een synthetische stem te horen, die door naar de stem van de spreker wordt overgezet en klinkt als de stem van die persoon. Bovendien wordt de videosynthese zo gestuurd dat de lippen van de spreker daarbij synchroon met het geluid bewegen”, aldus Waibel, die al tientallen jaren onderzoek doet op het gebied van spraakherkenning, -verwerking en -spraakvertaling.

Hele lage bandbreedte

In de onderzeeër is door de KIT- en CMU-onderzoekers met een krachtige laptop eerst de spraak van verschillende sprekers in dialoog omgezet in tekst. Geselecteerde tekstfragmenten kunnen dan via sonar naar de oppervlakte worden gezonden. Daar wordt de tekst dan weer omgezet in een video. Nieuw hier is de omzetting van een synthetische neutrale stem in de individuele stemmen van de respectieve sprekers en videosynthese, die lipsynchroon de video van de respectieve sprekers in de dialoog synthetiseert. De methode maakt het mogelijk videoconferenties over een geringe bandbreedte uit te zenden: “Dit zal in de toekomst communicatie in gesproken taal vergemakkelijken”, aldus Waibel. Maar het is ook geschikt voor het synthetiseren van video’s in een andere taal of voor lipsynchronisatie van video’s.

‘Lecture Translator’

Waibel heeft in het verleden ook al het nodige pionierswerk op dit terrein verricht en bouwt hierop voort met deze technologie. Op het KIT wordt bijvoorbeeld de door hem ontwikkelde ‘Lecture Translator’ gebruikt. Hiermee worden automatisch de voordrachten van sprekers tijdens colleges opgenomen en simultaan wordt de spraak vertaalt in geschreven Engels; studenten kunnen de lezing volgen via laptop, smartphone of tablet.